近日,機(jī)械與電子工程學(xué)院田富洋副教授團(tuán)隊在期刊《Computers and Electronics in Agriculture》在線發(fā)表了題為“An efficient multi-task convolutional neural network for dairy farm object detection and segmentation”的研究論文。田富洋副教授為該論文的第一作者,王中華教授和于鎮(zhèn)偉副教授為該論文的通訊作者。

自走式牛場推料機(jī)器人具有推料及時、勞動強(qiáng)度低、節(jié)約飼料等優(yōu)點,是實現(xiàn)智能化、數(shù)字化養(yǎng)殖的關(guān)鍵裝備。自走式推料機(jī)器人將廣泛的應(yīng)用于奶牛養(yǎng)殖中。作業(yè)時,自走式推料機(jī)器人需要在復(fù)雜多變的牛場環(huán)境中檢測出不同類型和尺寸的目標(biāo),如奶牛、人員、車輛、柵欄等。根據(jù)檢測的不同目標(biāo)采取相應(yīng)行動,如避讓、停止、警告等。這些作業(yè)任務(wù)對檢測算法的精度和速度都有較高的要求,而現(xiàn)有的目標(biāo)檢測算法難以同時滿足這些要求。

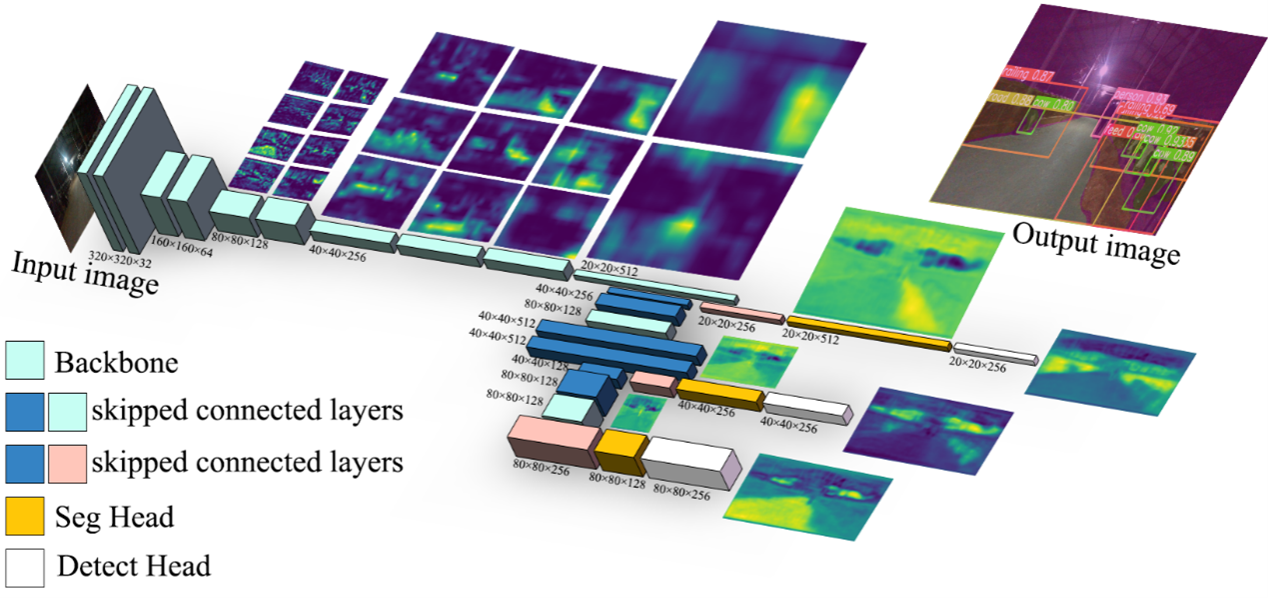

圖1. 多任務(wù)牛舍目標(biāo)識別與分割模型結(jié)構(gòu)圖

因此,本研究提出了一種基于多任務(wù)學(xué)習(xí)的牛場多類型目標(biāo)識別與分割模型Ghost CBAM Segmentation-Multi-task (GCS-MUL)。首先,根據(jù)奶牛精準(zhǔn)養(yǎng)殖需求,研制了奶牛飼料制備、布料、推料一體化機(jī)器人;第二,根據(jù)牛場目標(biāo)的特點及機(jī)器人的工作特性,設(shè)計了牛場多目標(biāo)識別模型,該模型融合CBAM模塊,并采用自主設(shè)計的輕量化目標(biāo)特征提取網(wǎng)絡(luò)GCNet作為整個模型的骨干網(wǎng)絡(luò);第三,為提高模型多尺度特征融合水平,頸部網(wǎng)絡(luò)利用了GhostConv和CSPGhost模塊構(gòu)建特征金字塔網(wǎng)絡(luò)和路徑聚合網(wǎng)絡(luò);最后,為實現(xiàn)牛場多目標(biāo)實時語義分割目的,由特征融合、新型感受野和金字塔池化等模塊共同融合構(gòu)成分割頭。試驗結(jié)果表明,牛場目標(biāo)的mAP@0.5達(dá)到94.86%;相較于YOLOv5模型,準(zhǔn)確率和召回率分別提升7.47%和6.85%,相較于YOLOv7目標(biāo)檢測模型,準(zhǔn)確率提升了5.1%;相較于SSD模型,模型大小減少了92.43%,平均檢測時間提升了84.37 ms,滿足了實時目標(biāo)識別的要求;平均檢測時間為66.43 ms,更適合配置于嵌入式設(shè)備;相較于不引入分割頭的網(wǎng)絡(luò),準(zhǔn)確率、召回率和mAP@0.5分別提升了4.49%、4.92%和6.58%。該研究成果能夠為推料機(jī)器人牛場目標(biāo)實時高效識別提供精確的算法,為自主行走提供更加有效的道路和環(huán)境場景分割方法。

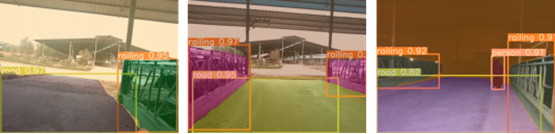

(a) 牛舍內(nèi)檢測結(jié)果

(b) 牛舍出口檢測結(jié)果

(c) 牛舍外檢測結(jié)果

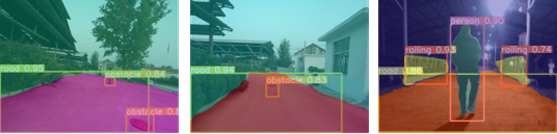

利用該模型輕量級的特點,將其配置在嵌入式人工智能計算機(jī)中,可實現(xiàn)的牛場白天和夜間的目標(biāo)識別與分割。該研究為推料機(jī)器人牛場目標(biāo)實時高效識別提供精確的算法,為農(nóng)業(yè)機(jī)器人避障和自主路徑提取的進(jìn)一步研究提供了技術(shù)支持。

該研究得到了國家自然科學(xué)基金的資助。

論文鏈接:https://doi.org/10.1016/j.compag.2023.108000

編 輯:萬 千

審 核:賈 波